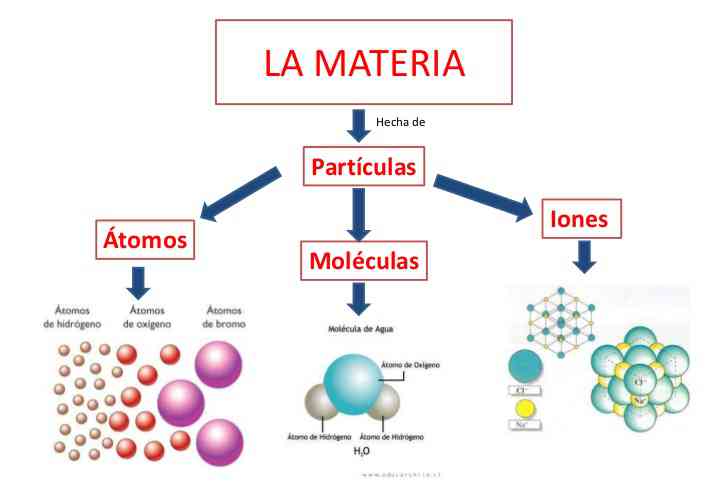

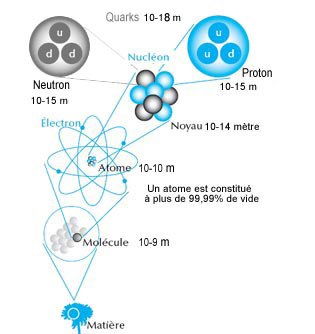

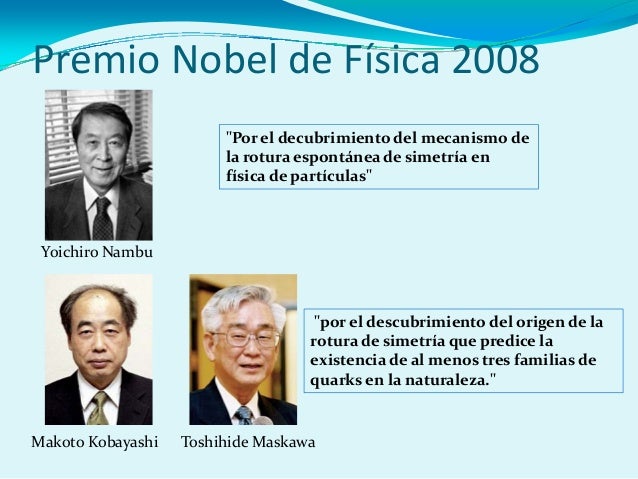

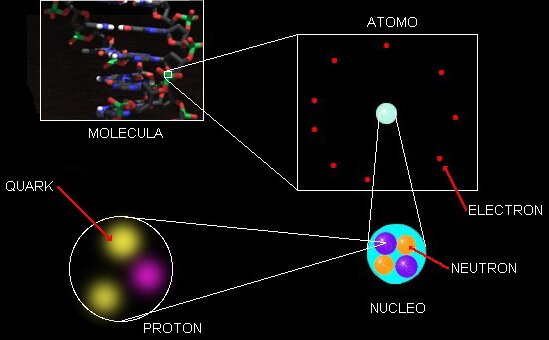

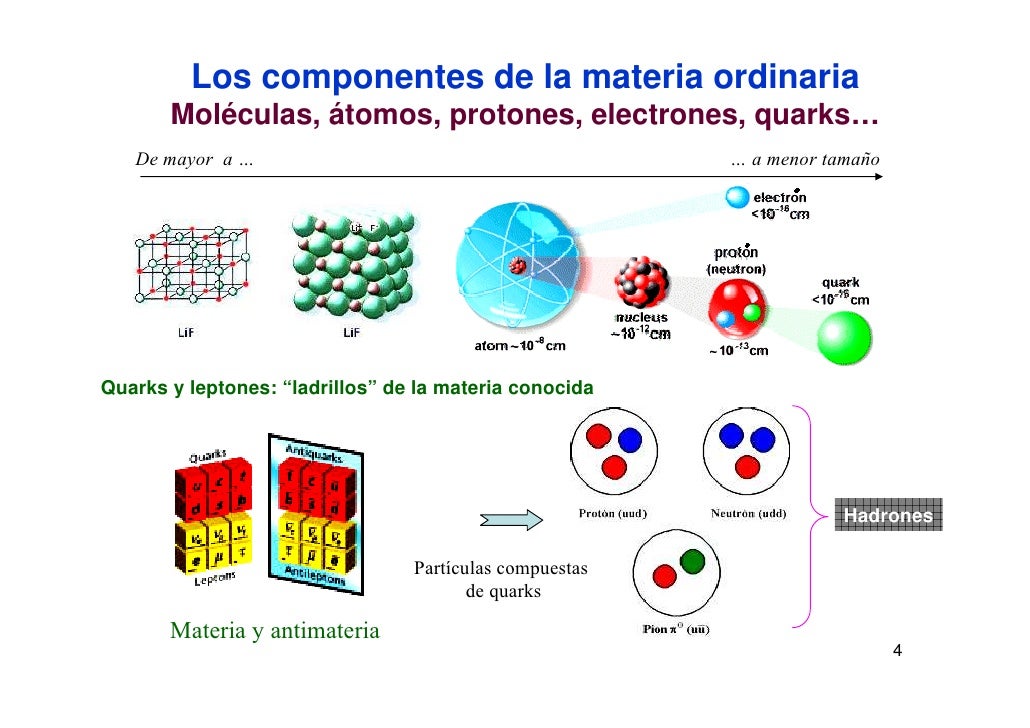

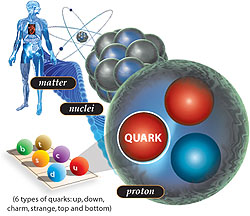

Adentrarse en el universo de las partículas que componen los elementos de la Tabla Periódica, y en definitiva, la materia conocida, es verdaderamente fantástico”. Esos pequeños objetos que no podemos ver, de dimensiones infinitesimales, son, en definitiva, los componentes de todo lo que contemplamos a nuestro alrededor: Las montañas, ríos, Bosques, océanos, los más exoticos animales y, nosotros mismos, estamos hechos de Quarks y Leptones que, en nuestro caso, han podido evolucionar hasta llegar…¡A los pensamientos!

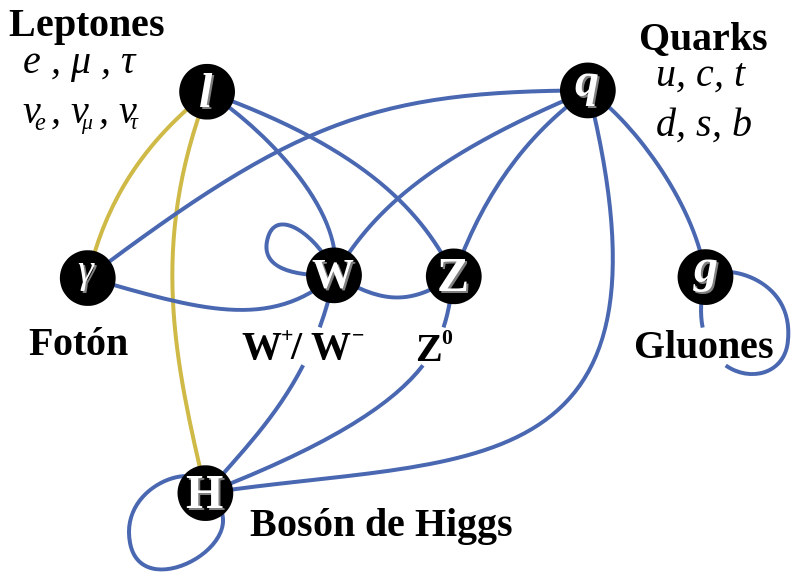

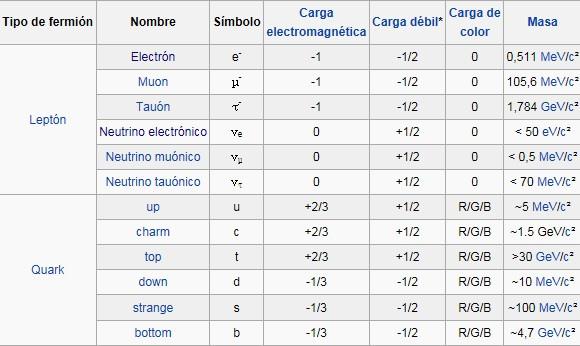

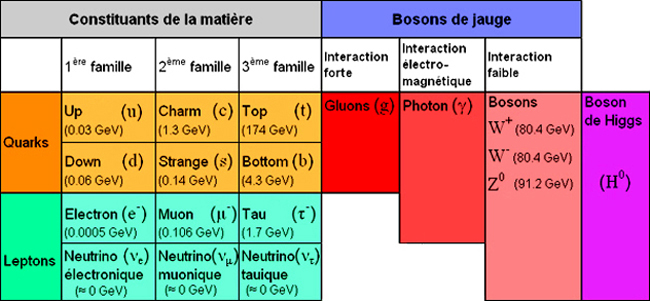

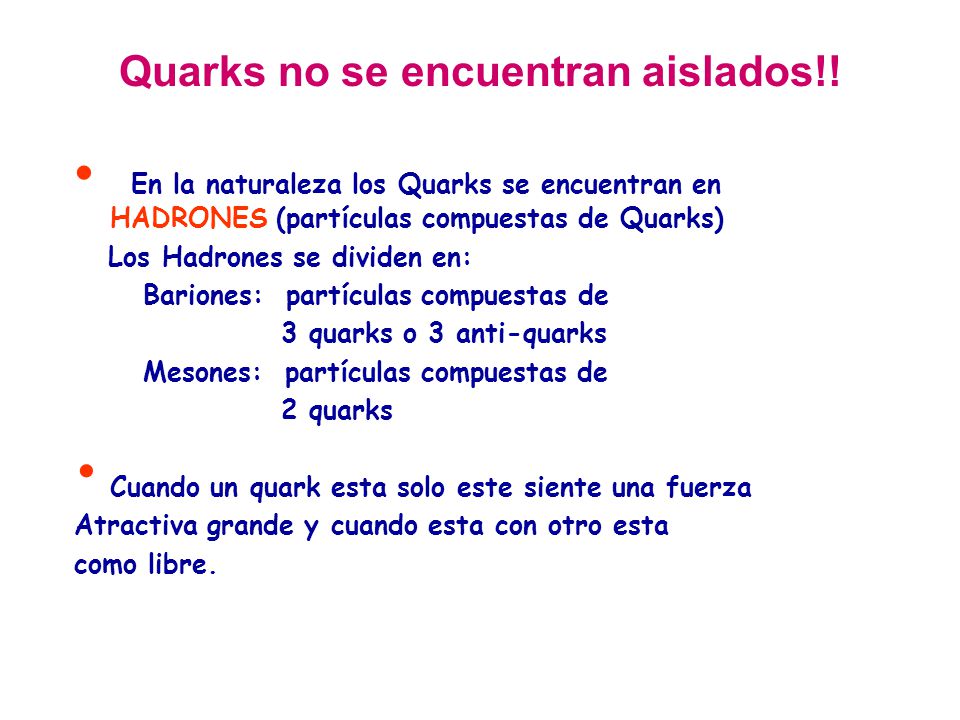

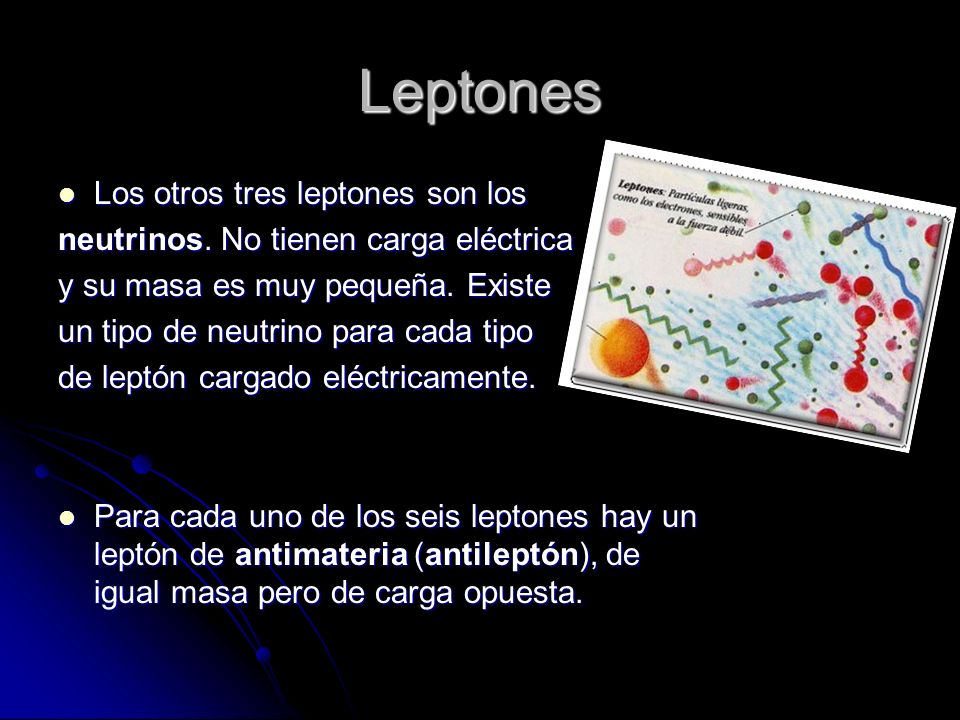

Quarks y Leptones, dos familias de partículas elementales que lo conforman todo

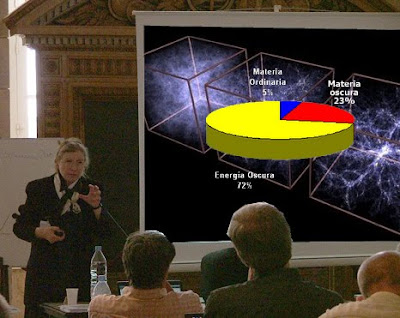

Estas dos familias de partículas conforman todo lo que podemos ver a nuestro alrededor, la materia del Universo y, si la “materia oscura” en realidad existe, no sabemos de qué pueda estar hecha y las clases de partículas que la puedan conformar. Habrá que esperar y, de , hablaremos de lo que conocemos.

El matrimonio Jolit-Curie en el Laboratorio

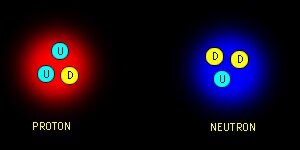

Tan pronto como los Joliot-Curie crearon el primer isótopo radiactivo artificial, los físicos se lanzaron en tropel a producir tribus enteras de ellas. En realidad, las variedades radiactivas de elemento en la tabla periódica son producto de laboratorio. En la moderna tabla periódica, cada elemento es una familia con miembros estables e inestables, algunos procedentes de la naturaleza, otros sólo del laboratorio. Por ejemplo, el hidrógeno presenta tres variedades: en primer lugar, el corriente, que tienen un solo protón.

Harold Urey

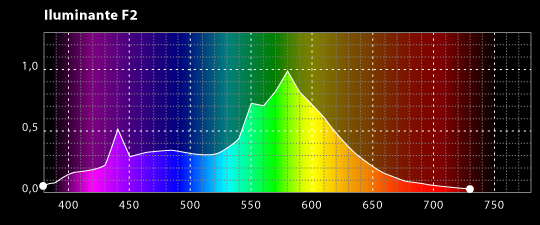

En 1.932, el químico Harold Urey logró aislar el segundo. Lo consiguió sometiendo a lenta evaporación una gran cantidad de agua, de acuerdo con la teoría de que los residuos representarían una concentración de la más pesada del hidrógeno que se conocía, y, en efecto, cuando se examinaron al espectroscopio las últimas gotas de agua no evaporadas, se descubrió en el espectro una leve línea cuya posición matemática revelaba la presencia de hidrógeno pesado.

No todo ha sido bueno entonces pero, teníamos que avanzar en el saber y, la clave está en saber utilizar adecuadamente esos conocimientos.

El núcleo de hidrógeno pesado está constituido por un protón y un neutrón. Como tiene un másico de 2, el isótopo es hidrógeno. Urey llamó a este átomo deuterio (de la voz griega deutoros, “segundo”), y el núcleo deuterón. Una molécula de agua que contenga deuterio se denomina agua pesada, que tiene puntos de ebullición y congelación superiores al agua ordinaria, ya que la masa del deuterio es dos veces mayor que la del hidrógeno corriente. Mientras que ésta hierve a 100º C y se congela a 0º C, el agua pesada hierve a 101’42º C y se congela a 3’79º C. El punto de ebullición del deuterio es de -23’7º K, frente a los 20’4º K del hidrógeno corriente. El deuterio se presenta en la naturaleza en la proporción de una por cada 6.000 partes de hidrógeno corriente. En 1.934 se otorgó a Urey el premio Nobel de Química por su descubrimiento del deuterio.

El deuterio resultó ser una partícula muy valiosa para bombardear los núcleos. En 1.934, el físico australiano Marcus Lawrence Edwin Oliphant y el austriaco P. Harteck atacaron el deuterio con deuterones y produjeron una tercera de hidrógeno, constituido por un protón y dos neutrones. La reacción se planteó así:

hidrógeno 2 + hidrógeno 2 = hidrógeno 3 + hidrógeno 1

Este hidrógeno superpesado se denominó tritio (del griego tritos, “tercero”); su ebullición a 25º K y su fusión a 20’5º K.

Como me pasa con frecuencia, me desvío del tema y sin poderlo evitar, mis ideas (que parecen tener vida propia), cogen los caminos más diversos. Basta con que se cruce en el camino del que realizo un fugaz recuerdo; lo sigo y me lleva a destinos distintos de los que me propuse al comenzar. Así, en este caso, me pasé a la química, que también me gusta mucho y está directamente relacionada con la física; de hecho son hermanas: la madre, las matemáticas, ese lenguaje especial que hablamos cuando las palabras no pueden explicar las cosas, y, la única, que finalmente lo podrá explicar todo lo complejo que existe en la Naturaleza.

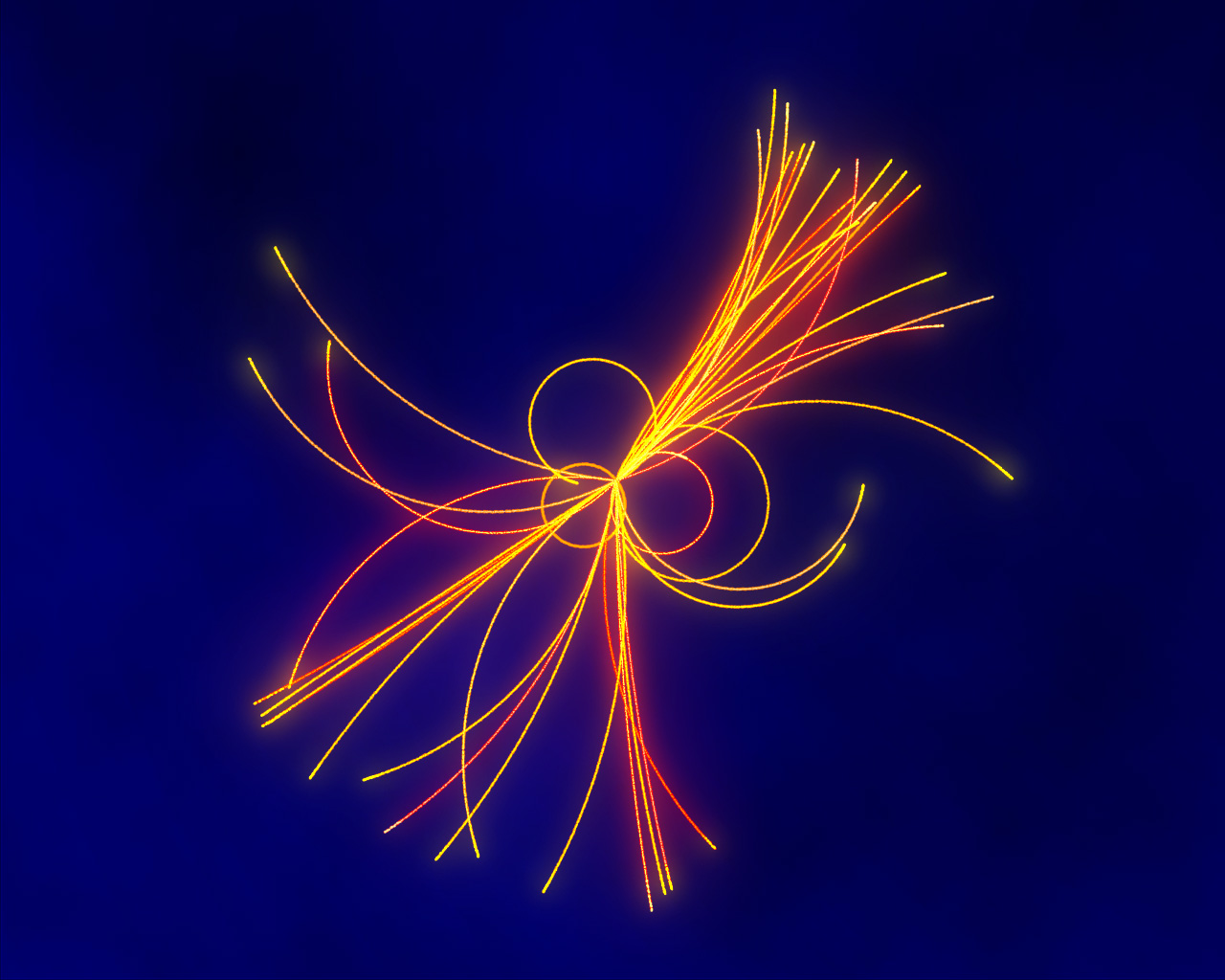

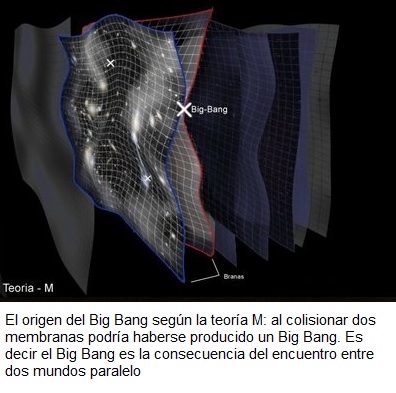

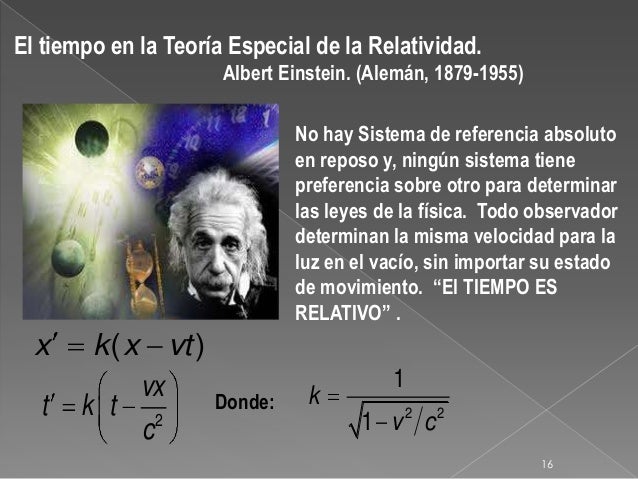

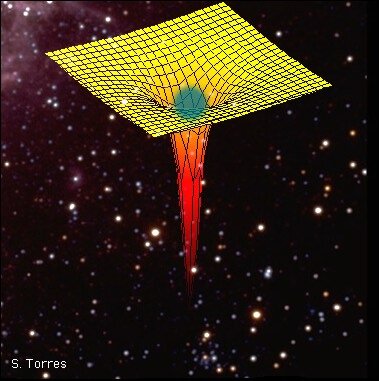

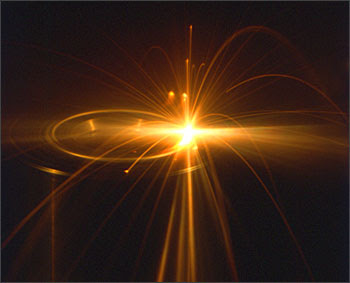

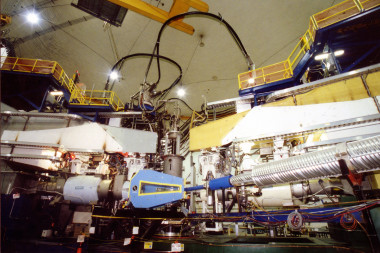

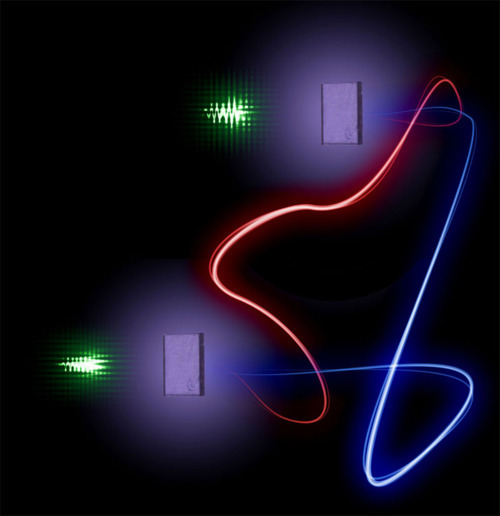

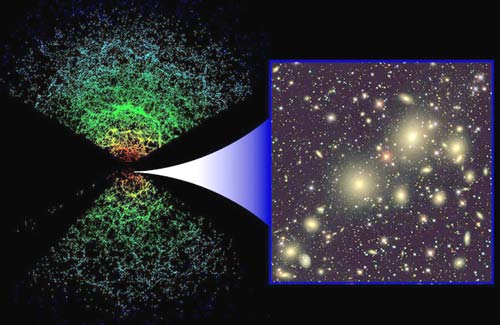

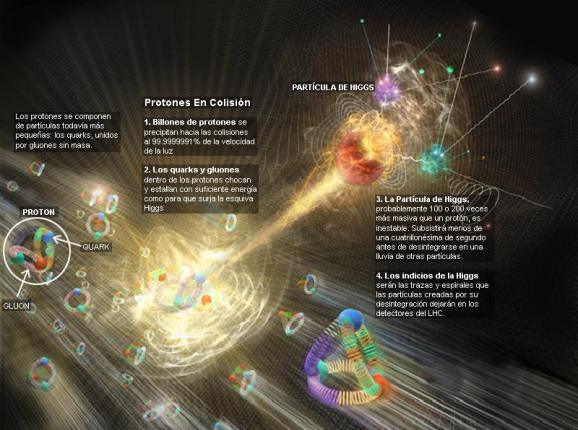

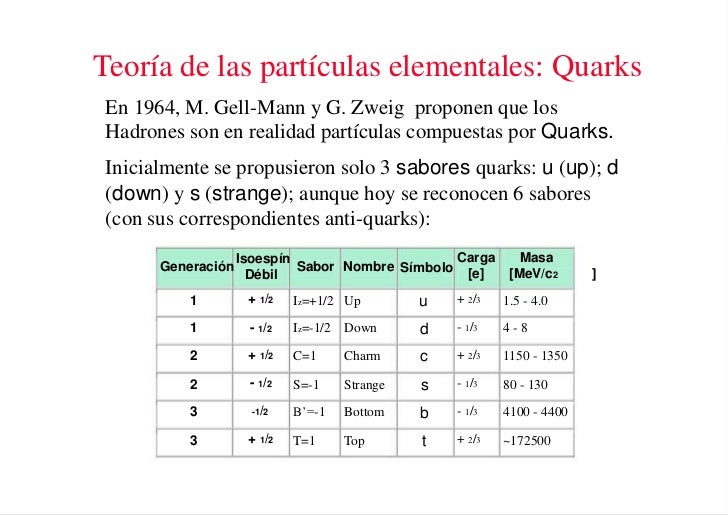

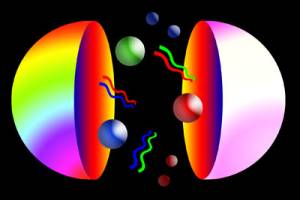

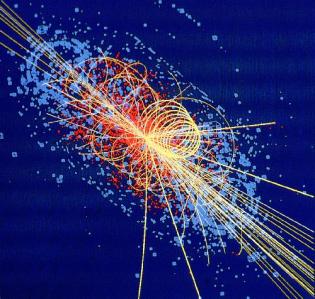

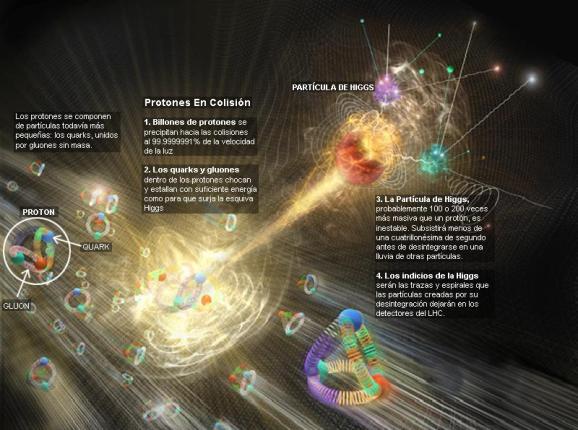

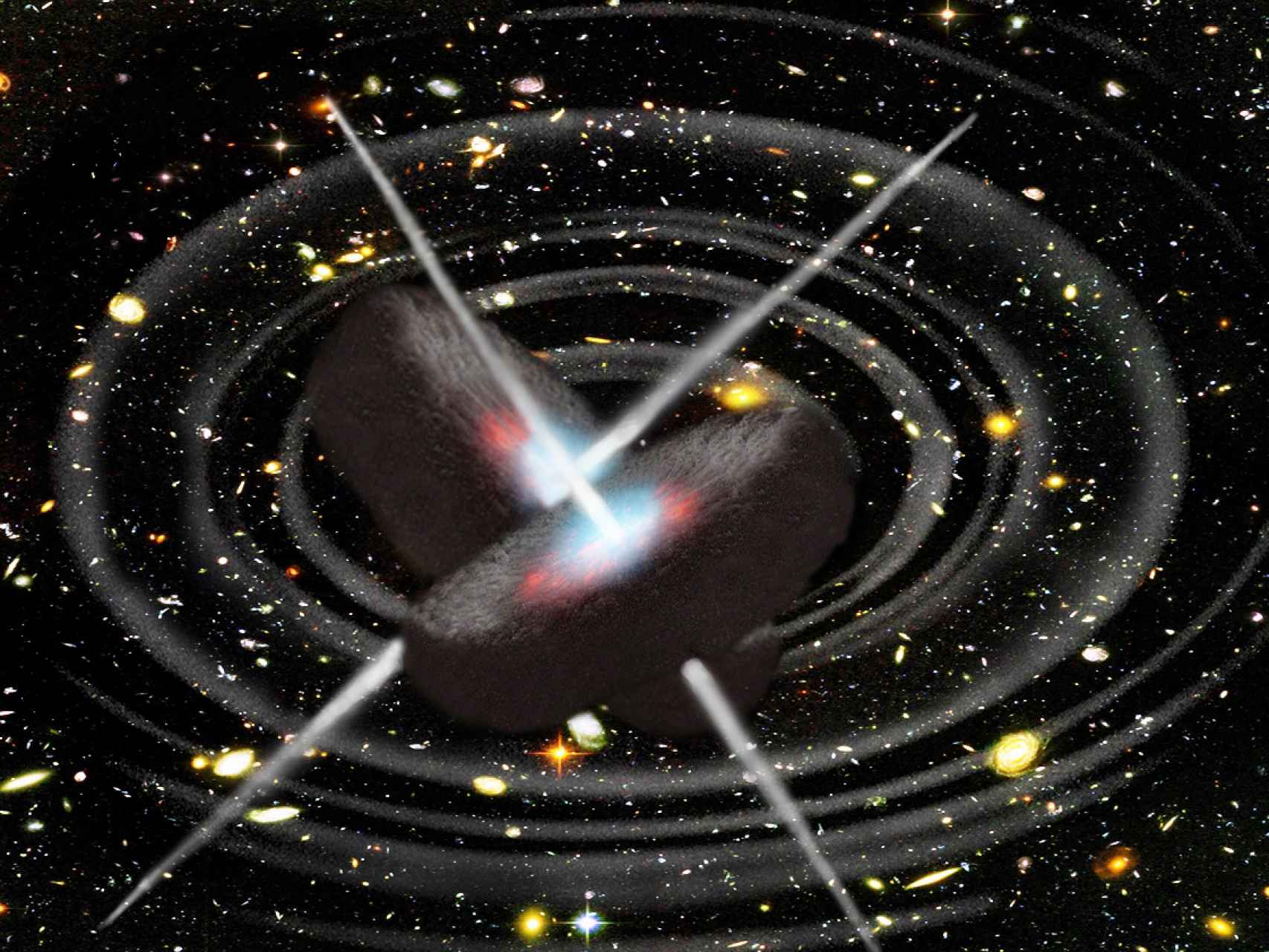

En Ginebra.- Físicos en el centro de investigación CERN están logrando colisiones de alta carga energética de partículas subatómicas en su intento por recrear las inmediatamente posteriores al Big Bang, el cual llevó al inicio del universo 13.700 millones de años atrás. Mucho se ha criticado al LHC y, sin embargo, es un gran paso adelante que nos posibilitará saber, es el Universo y, nos descubrirá algunos de sus secretos. Hará posible que avancemos en el conocimiento sobre de dónde venimos, cómo el universo temprano evolucionó, cómo tienen y adquieren su masa las partículas y, algunas cosas más.

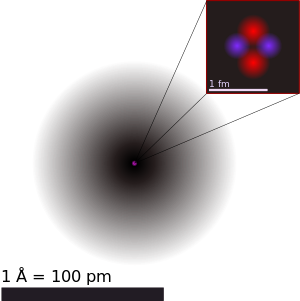

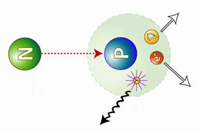

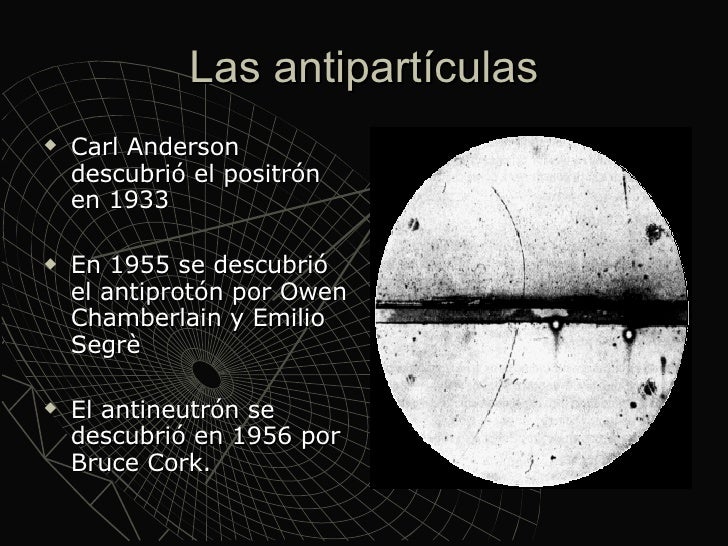

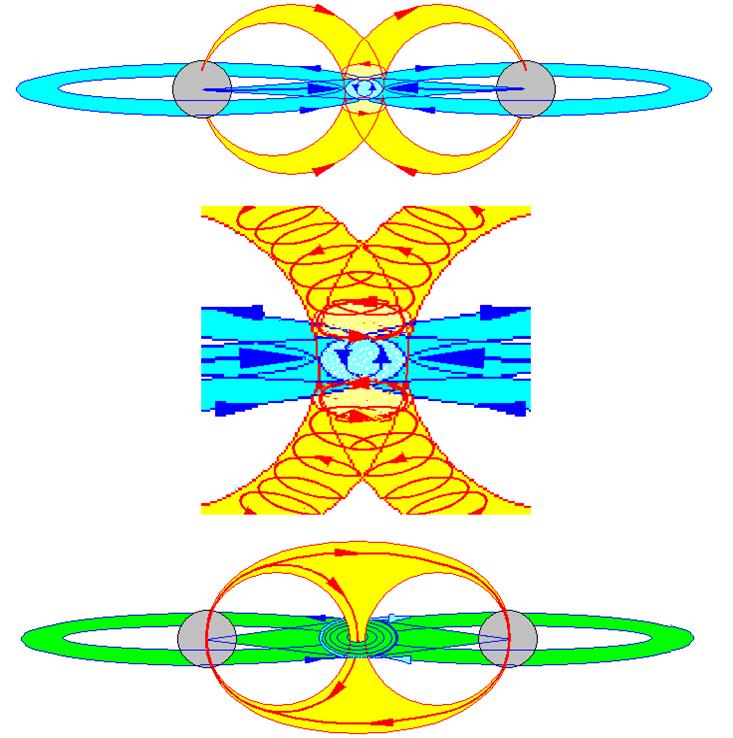

Todo eso se logra mediante las colisiones de haces partículas que son lanzadas a velocidades relativistas y que, al chocar con otro lanzado en el sentido contrario, producen el efecto que arriba en la imagen podeis ver, es como recrear el de la creación, es decir, el big bang en miniatura. La materia se descompone en otras partículas más simples, se llega hasta las entrañas más profundas para poder estudiarla y saber.

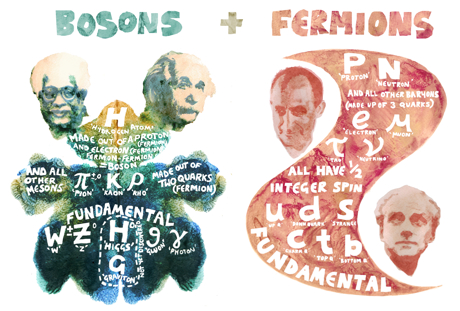

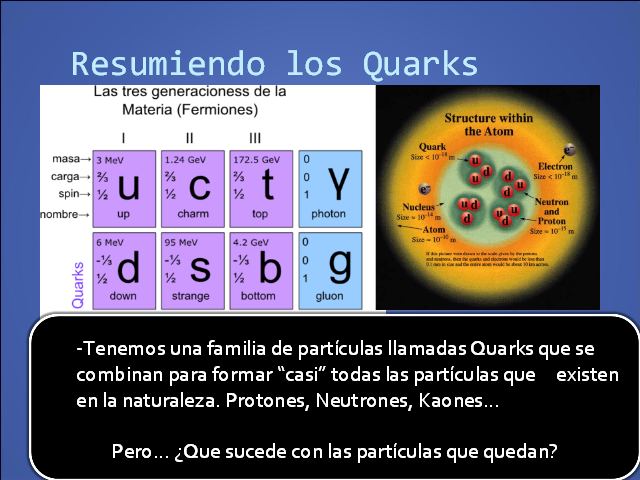

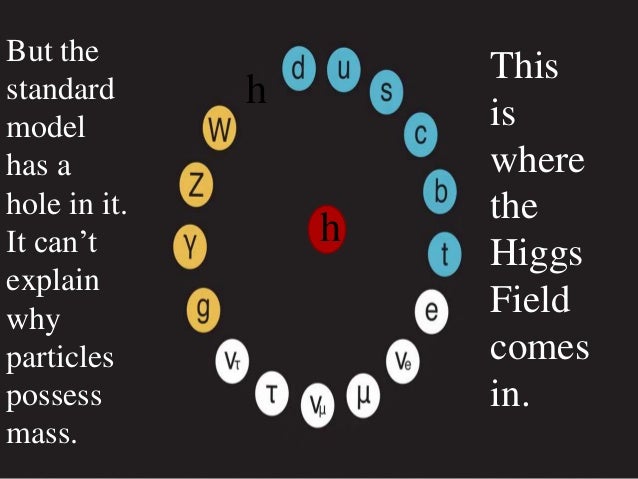

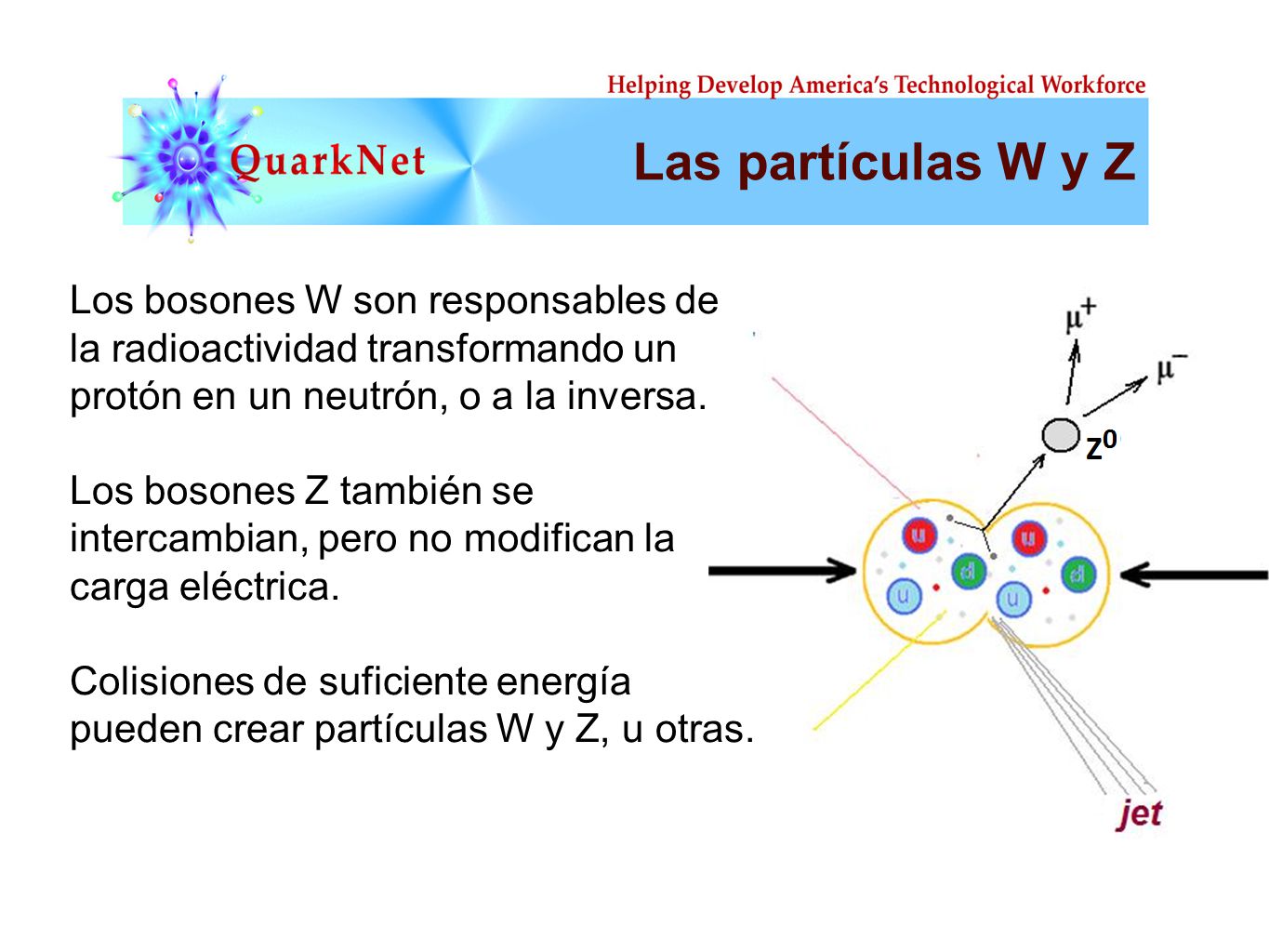

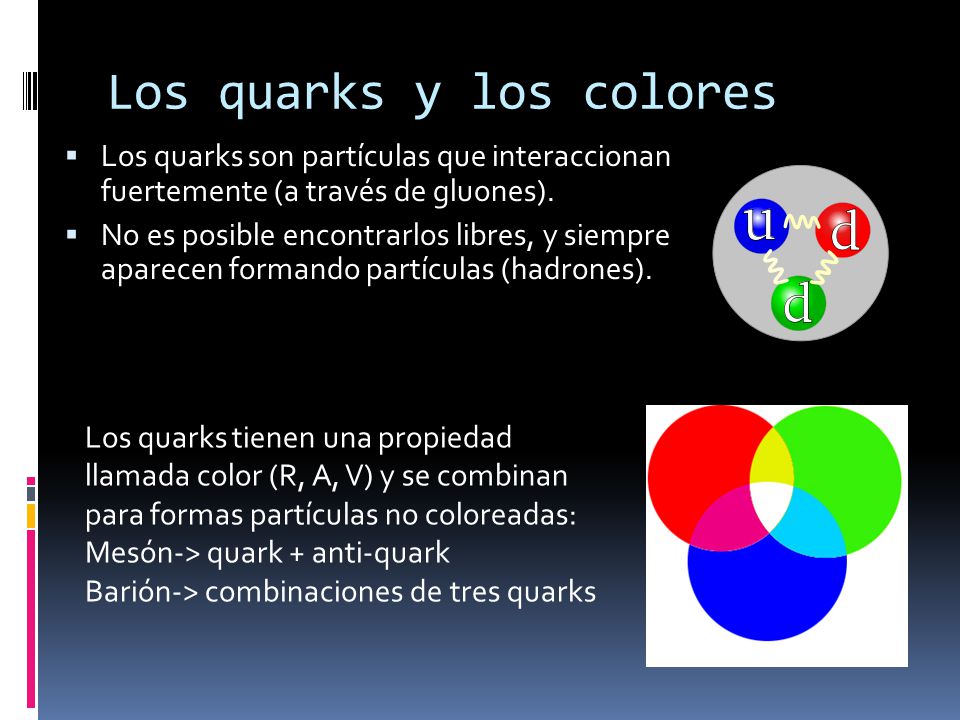

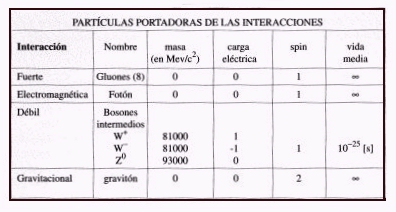

Los Bosones son las partículas mediadoras de las cuatro fuerzas

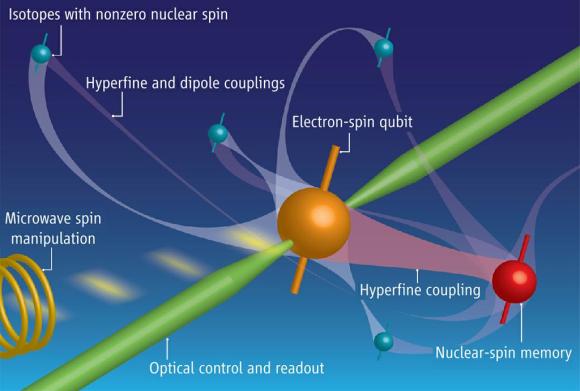

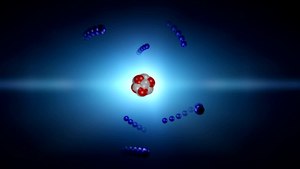

La colisión de un quark (la esfera roja) un protón (la esfera naranja) con un gluon (la esfera verde) otro protón con espín opuesto. El espín está representado por las flechas azules alrededor de los protones y del quark. Los signos de interrogación azules alrededor del gluon representan la pregunta: ¿Están los gluones polarizados? Las partículas expulsadas de la colisión son una lluvia de quarks y un fotón (la esfera púrpura).

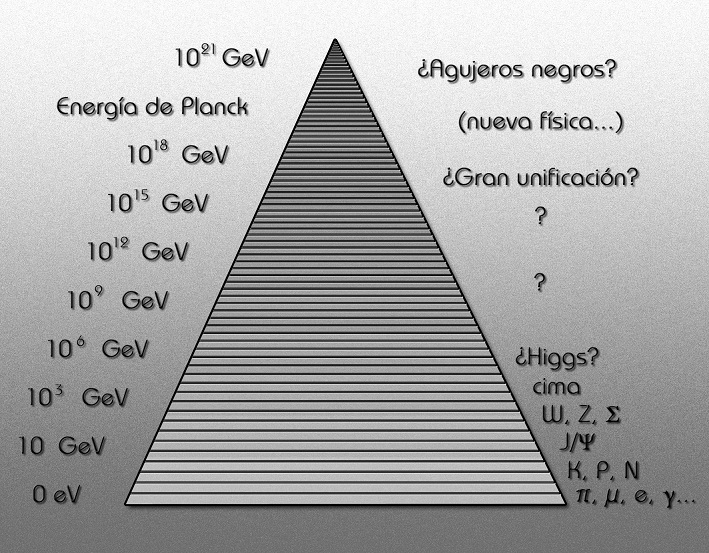

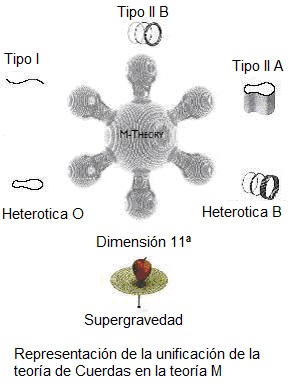

La escala de energía es la que marcará nuestro nivel de conocimiento del Universo

El Gran Colisionador de Hadrones (LHC), la mayor máquina del mundo en su , colisionó rayos de partículas a un récord de energía de 7 teraelectrón voltio (TeV), tres veces y medio más rápido de lo conseguido anteriormente en un acelerador de partículas. Sin embargo, hasta que podamos llegar a la energía de Planck, para poder atisbar las cuerdas, falta mucho, muchísimo camino que recorrer…si finalmente, lo podemos lograr.

Una manera de ver la Naturaleza “por dentro” es hacer que haces de partículas choquen de manera violenta sí y nos enseñen de qué están hechas

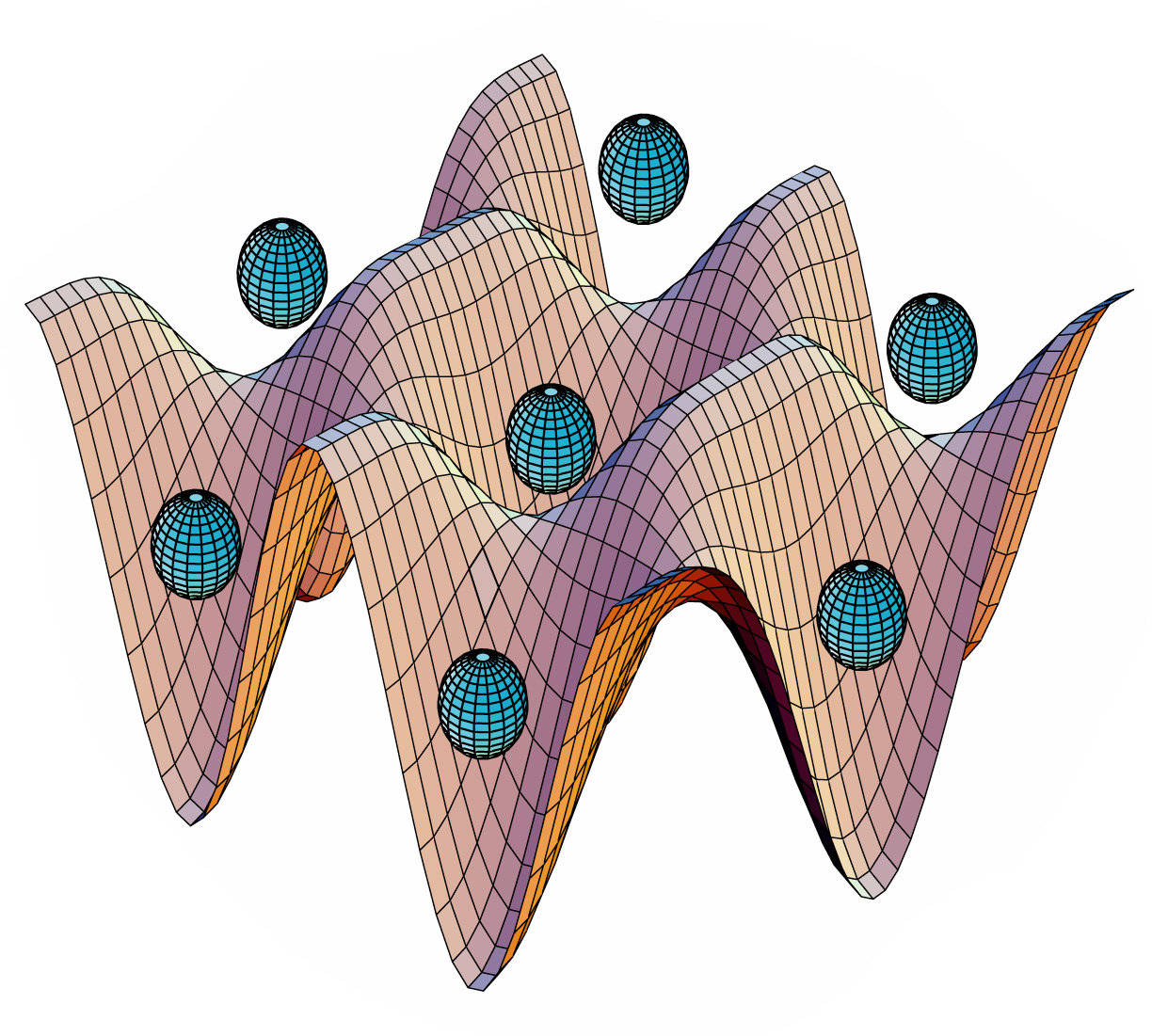

Los científicos quieren creer que la naturaleza prefiere la economía en sus creaciones y que siempre parece evitar redundancias innecesarias al crear estructuras físicas, biológicas y químicas. La Naturaleza, siempre lleva su dinámica al ritmo más económico posible, no se produce absolutamente nada que sea superfluo, sino que, con lo estrictamente necesario, todo transcurre debe.

… las dos partículas sólo pueden subsistir en el mismo estado (una situación característica compartida) si uno de ellos invierte su espín respecto al otro …

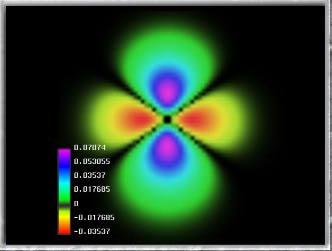

Estamos hablando de las partículas y no podemos dejar a un lado el tema del movimiento rotatorio de las mismas. Usualmente se ve cómo la partícula gira sobre su eje, a semejanza de un trompo, o como la Tierra o el Sol, o nuestra galaxia o, si se me permite decirlo, como el propio universo. En 1.925, los físicos holandeses George Eugene Uhlenbeck y Samuel Abraham Goudsmit aludieron por primera vez a esa rotación de las partículas. Éstas, al girar, generan un minúsculo campo electromagnético; tales campos han sido objeto de medidas y exploraciones, principalmente por del físico alemán Otto Stern y el físico norteamericano Isaac Rabi, quienes recibieron los premios Nobel de Física en 1.943 y 1.944 respectivamente, por sus trabajos sobre dicho fenómeno.

Esas partículas (al igual que el protón, el neutrón y el electrón), que poseen espines que pueden medirse en números mitad, se consideran según un sistema de reglas elaboradas independientemente, en 1.926, por Fermi y Dirac; por ello, se las llama y conoce como estadísticas Fermi-dirac. Las partículas que obedecen a las mismas se denominan fermiones, por lo cual el protón, el electrón y el neutrón son todos fermiones.

Estadística Fermi-Dirac para las Fermiones. La estadística de Fermi-Dirac es la de contar estados de ocupación de forma estadística en un sistema de fermiones fermiones. Forma parte de la Mecánica Estadística. Y tiene aplicaciones sobre todo en la Física del sólido.

Hay también partículas cuya rotación, al duplicarse, resulta igual a un par. Para manipular sus energías hay otra serie de reglas, ideadas por Einstein y el físico indio S. N. Bose. Las partículas que se adaptan a la estadística Bose-Einstein son bosones, como por ejemplo la partícula alfa.

Estadística Bose-Einstein para los Bosones

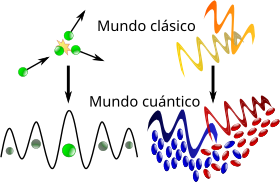

Las reglas de la mecánica cuántica tienen que ser aplicadas si queremos describir estadísticamente un sistema de partículas que obedece a reglas de teoría en vez de los de la mecánica clásica. En estadística cuántica, los estados de energía se considera que están cuantizados. La estadística de Bose-Einstein se aplica si cualquier de partículas puede ocupar un estado cuántico dado. Dichas partículas son bosones, que tienden a juntarse.

“Justifiquemos porqué el momento angular “intrínseco” de spin posee tal inclinación, y por qué ésta, en ausencia de interacciones específicas, se mantiene estable.” Nos dice Fandila Soria en su trabajo “La Física Fácil”

“La alemana Emmy Noether, una de las matemáticas más grandes de todos los tiempos, demostró que la invariancia del momento lineal o del momento angular son consecuencias necesarias de la invariancia de las leyes de la física frente a traslaciones o rotaciones en el espacio. Es decir, que puedo jugar al billar con las mismas reglas y esperar el mismo comportamiento de las bolas si muevo la mesa un par de metros en cualquier dirección, o si la giro 90º, 30º o cualquier ángulo, suponiendo, claro, que tras dichas traslaciones o giros dejo la mesa perfectamente nivelada.”

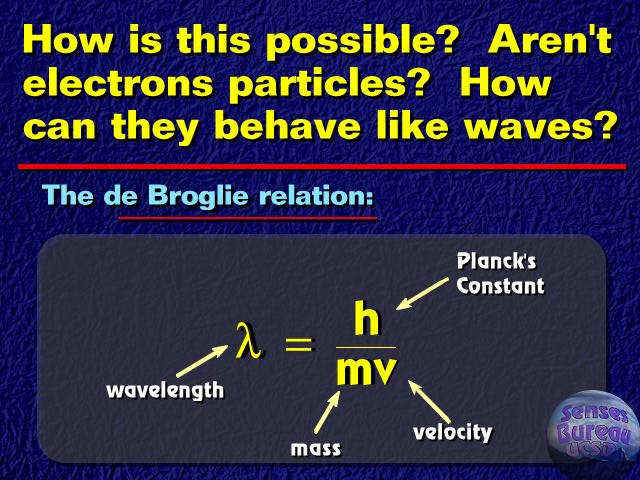

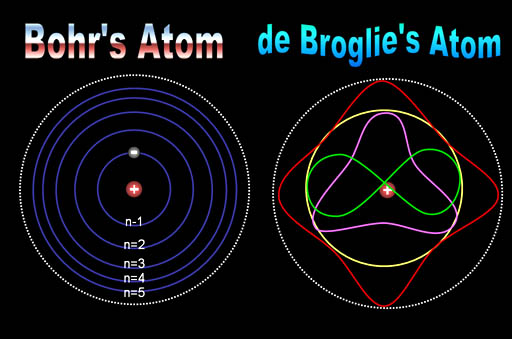

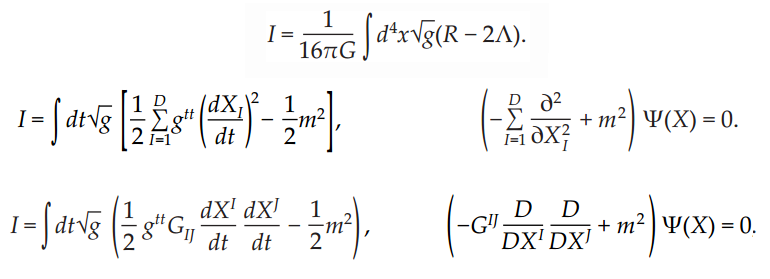

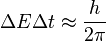

Los bosones tienen un momento angular nh/2π, donde n es 0 o un entero, y h es la constante de Planck. Para bosones idénticos, la función de ondas es siempre simétrica. Si sólo una partícula puede ocupar un cuántico, tenemos que aplicar la estadística Fermi-Dirac y las partículas (como también antes dije) son los fermiones que tienen momento angular (n + ½)h / 2π y cualquier función de ondas de fermiones idénticos es siempre antisimétrica. La relación entre el espín y la estadística de las partículas está demostrada por el teorema espín-estadística. El teorema de la estadística del espín de la mecánica cuántica establece la relación directa entre el espín de una especie de partícula con la estadística que obedece. Fue demostrado por Fierz y Pauli en 1940, y requiere el formalismo de teoría cuántica de campos.

En un espacio de dos dimensiones es posible que haya partículas (o cuasipartículas) con estadística intermedia entre bosones y fermiones. Estas partículas se conocen con el de aniones; para aniones idénticos, la función de ondas no es simétrica (un cambio de fase de +1) o antisimétrica (un cambio de fase de -1), sino que interpola continuamente entre +1 y -1. Los aniones pueden ser importantes en el análisis del efecto Hall cuántico fraccional y han sido sugeridos como un mecanismo para la superconductividad de alta temperatura.

Debido al principio de exclusión de Pauli, es imposible que dos fermiones ocupen el mismo cuántico (al contrario de lo que ocurre con los bosones). La condensación Bose-Einstein es de importancia fundamental para explicar el fenómeno de la superfluidez. A temperaturas muy bajas (del orden de 2×10-7 K) se puede formar un condensado de Bose-Einstein, en el que varios miles de átomos dorman una única entidad (un superátomo). Este efecto ha sido observado con átomos de rubidio y litio. Como ha habréis podido suponer, la condensación Bose-Einstein es llamada así en honor al físico Satyendra Nath Bose (1.894 – 1.974) y a Albert Einstein. Así que, el principio de exclusión de Pauli tiene aplicación no sólo a los electrones, sino también a los fermiones; pero no a los bosones.

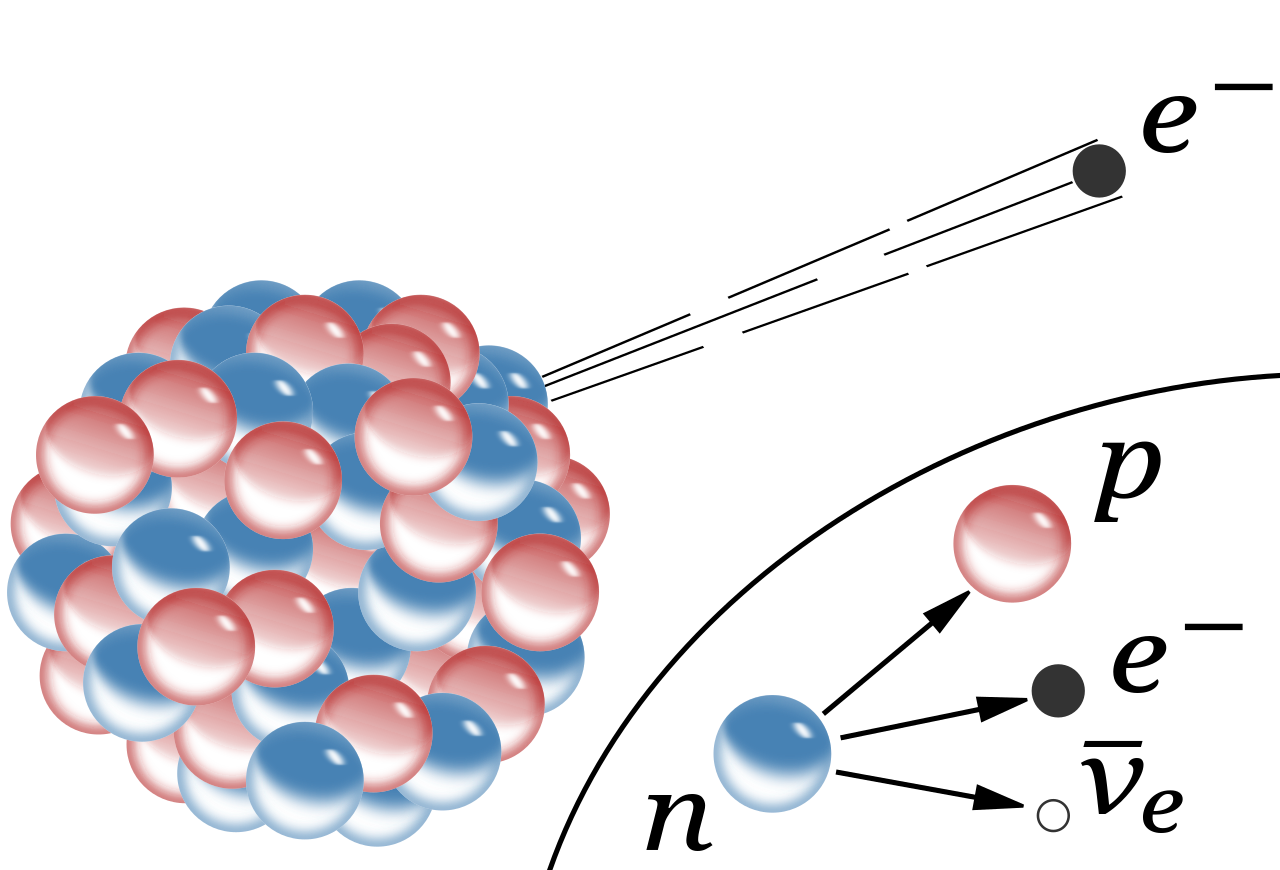

Si nos fijamos en todo lo que estamos hablando aquí, es fácil comprender cómo un campo magnético la partícula cargada que gira, pero ya no resulta tan fácil saber por qué ha de hacer lo mismo un neutrón descargado. Lo cierto es que cuando un rayo de neutrones incide sobre un hierro magnetizado, no se comporta de la misma que lo haría si el hierro no estuviese magnetizado. El magnetismo del neutrón sigue siendo un misterio; los físicos sospechan que contiene cargas positivas y negativas equivalente a cero, aunque por alguna razón desconocida, logran crear un campo magnético cuando gira la partícula. Es de especial interés ya que los momentos magnéticos aparecen por el movimiento de cargas eléctricas, y puesto que el neutrón es una partícula neutra, ese magnético da indicios de la existencia de una substructura, es decir, que el neutrón está constituido por otras partículas, eléctricamente cargadas (¿Quarks?)

en las estrellas de neutrones está presente el campo magnético

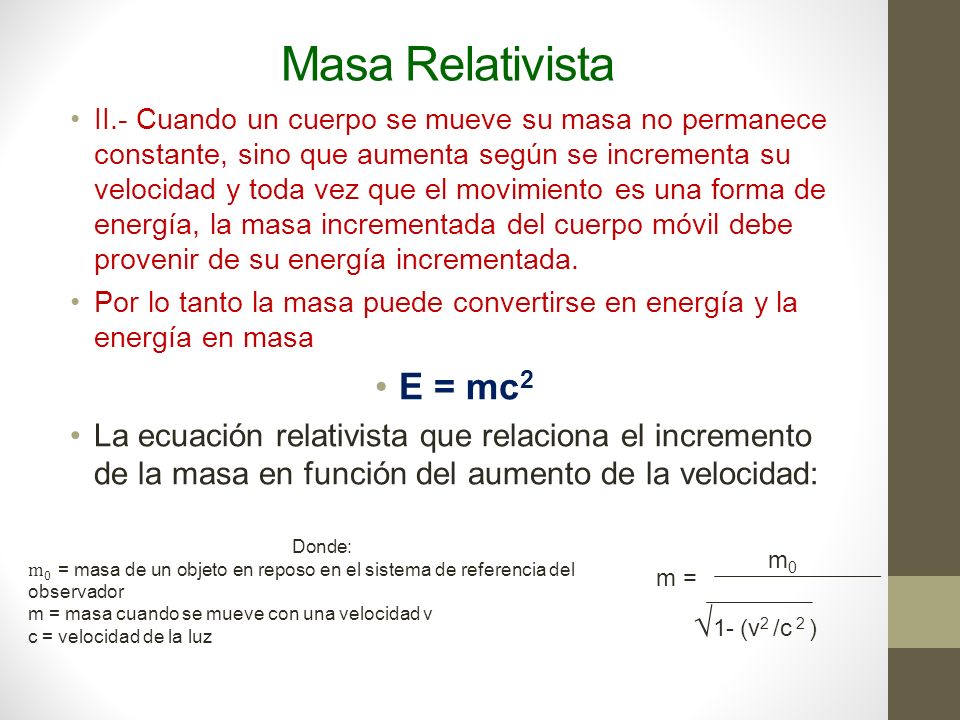

Particularmente creo que, si el neutrón tiene masa, si la masa es energía (E = mc2), y si la energía es electricidad y magnetismo (según Maxwell), el magnetismo del neutrón no es tan extraño, sino que es un aspecto de lo que en realidad es: materia. La materia es la luz, la energía, el magnetismo, en definitiva, la fuerza que reina en el universo y que está presente de una u otra en todas partes (aunque no podamos verla).Y, la explicación más sencilla es que, el Neutrón tenga carga positiva y negativa que se anulan mutuamente, y, de esa manera, adquiere su propiedad neutra.

emilio silvera

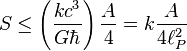

, es la constante de Boltzmann.

, es la constante de Boltzmann.  , es la vecolcidad de la luz.

, es la vecolcidad de la luz.  , es la constante gravitacional universal.

, es la constante gravitacional universal. , es la

, es la  , es la

, es la

en el sistema de unidades naturales conocido como las unidades de Planck.

en el sistema de unidades naturales conocido como las unidades de Planck.

es la

es la  es la

es la  es la velocidad de la luz en el vacío

es la velocidad de la luz en el vacío es la constante gravitacional

es la constante gravitacional

Los

Los

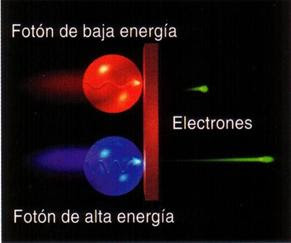

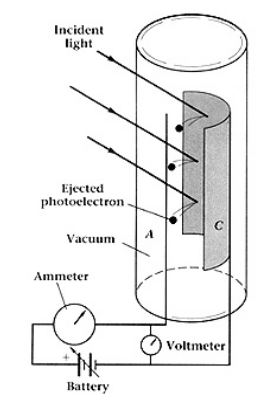

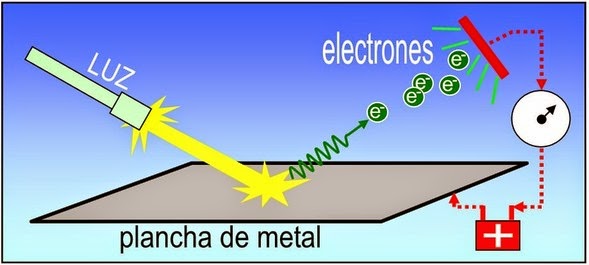

La energía mínima necesaria para arrancar un

La energía mínima necesaria para arrancar un

es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El

es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El

![[espejo.jpg]](http://1.bp.blogspot.com/_RbcHwhHyNUU/ShpFYOgM4zI/AAAAAAAAAYM/_aVI4zFB9pQ/s1600/espejo.jpg)